Vídeo: Google Y MIT han creado una manera de quitar Reflexiones, vallas y otros obstáculos molestos a partir de fotos

Si hay una cosa que hemos aprendido de varias cámaras de fotos y los productos de Google últimamente, es que la empresa es centrarse en el uso de algunos Loca linda tecnología para hacer su experiencia de captura de imágenes y compartir más automágico. Siguiente en la lista de Google? Reflejos molestos y obstrucciones de primer plano que hacen que sus imágenes especie de terrible. En concreto, las cosas como las cercas de ciclón y reflexiones en las ventanas o el resto del cristal. Básicamente, lo mejor es simplemente visualizarlo.

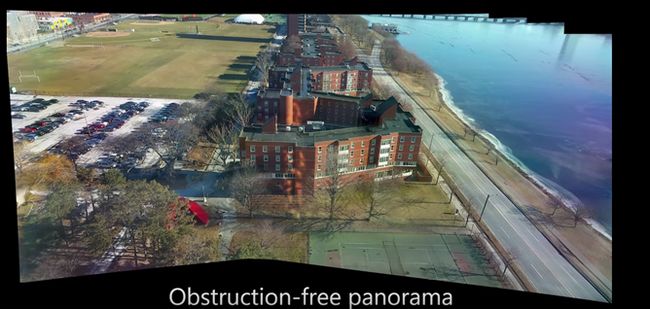

Google y el MIT se unieron en esta tecnología, y van a presentar una ponencia sobre el mismo en la conferencia Siggraph 2015 este mes. He aquí un vistazo más de cerca el proceso en una foto panorámica.

Como se puede ver, la foto tiene algunas reflexiones muy obvias, y ellos legítimamente casi arruinar la imagen. Ahora, con la tecnología de limpieza, esta foto se puede en realidad ser corregido. Y me refiero De Verdad corregida - la diferencia es absolutamente sorprendente.

Si te fijas bien, todavía hay algunos ocasionales strangness en la imagen corregida, pero es enormemente mejor que la original y elimina casi la totalidad de los objetos reflejados. Este proceso también es completamente automático - el usuario sólo tiene que capturar la imagen, no hay nada para seleccionar, resaltar o de control (a diferencia de muchas de las características más básicas de eliminación de objetos en cámaras de teléfonos inteligentes).

¿Cómo funciona? El diablo, como siempre, está en los detalles. Esta tecnología requiere múltiples marcos (5-7) para ser capturados en múltiples ángulos relativos, porque, obviamente, que hace: el equipo tiene que ser capaz de obtener lo que la imagen debería parecerse a fin de que para hacer las correcciones necesarias. Un solo cuadro no proporciona los puntos de datos comparativos que se requerirían para ello. Los investigadores sugieren en el siguiente video que unos segundos de captura debe ser suficiente, aunque no está claro cuánto movimiento es necesario a fin de que para obtener la cantidad de contrastar puntos de datos que necesita para funcionar de manera efectiva.

En cuanto a las implementaciones, eso no discuten. Ciertamente, esto es algo que Google sería muy interesado en el uso, tanto en Android y Google Photos, pero no está claro cómo es necesaria mucha potencia de cálculo para que sea eficaz. Si la respuesta es "mucho", eso significa que podría limitarse a un servicio de procesamiento basado en la nube, como Google Fotos. Si la respuesta es sólo "algunos", entonces tal vez una aplicación en el dispositivo que podría suceder.

Creo que en el lado de la captura de las cosas, es posible que este no sea muy difícil de poner en práctica bastante sin problemas si pueden conseguir la cantidad de material requerido a unos pocos segundos. La cámara podría amortiguar una pequeña cantidad de vídeo en la memoria de forma continua mientras el visor está activo, y luego, cuando se pulsa el obturador, el uso que amortiguada material para construir la foto de-obstruido.

También hay un video que explica cómo funciona la tecnología con más detalle, que se puede ver a continuación.

Usted puede consultar la página web para la presentación Siggraph aquí, y no hay un vínculo con el papel real sobre el sitio del MIT aquí (Advertencia: es un PDF 32 MB) que contiene grandes cantidades de matemáticas y física que yo no entiendo.

- Fuente:

- Vía:

- TechCrunch